Entenda o que é MLOps, como ele resolve o abismo entre criar modelos de machine learning e mantê-los funcionando e por que empresas data-driven precisam dessa disciplina para escalar IA com segurança.

Estudos de consultorias renomadas, como Gartner e VentureBeat, estimam que entre 85% e 90% dos projetos de machine learning nunca chegam à produção. Não por falta de talento técnico. Não por falta de dados. Mas por falta de uma estrutura que consiga levar um modelo do ambiente controlado do laboratório para o mundo real e mantê-lo funcionando com confiabilidade.

Esse é o problema que o MLOps resolve.

Neste artigo, você vai entender o que é MLOps, como ele funciona na prática, quais são seus componentes essenciais e como o Google Cloud suporta essa disciplina por meio do Vertex AI. Continue lendo para descobrir por que MLOps é a base sem a qual a inteligência artificial não escala.

MLOps: o que é?

MLOps (Machine Learning Operations) é a disciplina que une práticas de machine learning, engenharia de software e operações de infraestrutura para automatizar, padronizar e escalar o ciclo de vida completo de modelos de IA, do desenvolvimento ao monitoramento contínuo em produção.

Em uma definição mais direta: MLOps é o conjunto de processos, ferramentas e práticas que responde à pergunta que todo projeto de IA precisa responder “como garantir que o modelo criado pelo time de ciência de dados funcione de forma confiável, segura e escalável no ambiente real de negócio?”

De onde vem o MLOps?

O MLOps é inspirado diretamente no DevOps, a disciplina que transformou o desenvolvimento de software ao integrar desenvolvimento e operações. Assim como o DevOps resolveu o problema de colocar código em produção com velocidade e confiabilidade, o MLOps resolve o problema de colocar modelos de IA em produção com as mesmas propriedades: velocidade, confiabilidade e rastreabilidade.

A diferença é que modelos de machine learning têm uma natureza fundamentalmente diferente do software tradicional: eles aprendem com dados e os dados mudam. Um modelo treinado hoje pode estar desatualizado daqui a três meses, sem que uma linha de código tenha sido alterada.

O que é MLOps?

MLOps é a disciplina que resolve a lacuna entre criar modelos de machine learning e mantê-los funcionando em produção. É DevOps aplicado à inteligência artificial, com a complexidade adicional de que os dados (e não apenas o código) também precisam ser versionados, monitorados e atualizados continuamente.

Por que o MLOps é essencial para empresas?

Criar um modelo de machine learning que funciona bem em ambiente de testes é a parte mais fácil de um projeto de IA. O verdadeiro desafio começa depois:

- Como colocar o modelo em produção sem interromper sistemas existentes?

- Como garantir que o modelo continue funcionando bem quando o comportamento dos dados muda?

- Como atualizar o modelo sem criar risco para o negócio?

- Como rastrear qual versão do modelo está em produção e o que mudou entre versões?

- Como auditar e explicar as decisões do modelo para fins regulatórios ou de governança?

Sem MLOps, cada uma dessas perguntas é respondida de forma ad hoc, gerando inconsistências, retrabalho e risco operacional. Com MLOps, elas são respondidas por processos padronizados e automatizados.

O custo de não ter MLOps

Empresas que investem em projetos de IA sem estrutura de MLOps tipicamente enfrentam:

- “Model decay” silencioso: o modelo perde acurácia gradualmente sem que ninguém perceba, até que o impacto no negócio já é visível

- Dependência de pessoas, não de processos: o modelo só funciona porque alguém específico sabe como operá-lo

- Tempo de ciclo longo: retreinar e reimplantar um modelo pode levar semanas sem automação

- Falta de rastreabilidade: impossibilidade de responder “por que o modelo tomou essa decisão?” crítico em setores regulados

Como funciona o MLOps na prática: o ciclo completo

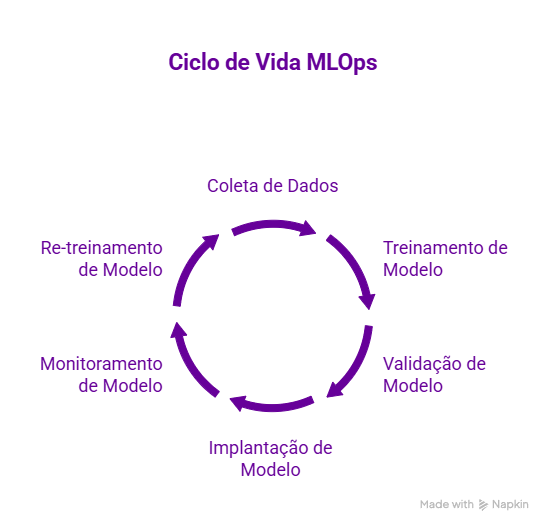

O MLOps opera sobre o ciclo de vida completo de um modelo de machine learning. Cada etapa tem práticas e ferramentas específicas:

Etapa 1: Coleta e preparação de dados

Dados são a matéria-prima de qualquer modelo. No MLOps, a coleta e preparação de dados são versionadas e rastreáveis: sabe-se exatamente quais dados foram usados em qual versão do modelo. Isso é chamado de data versioning e é fundamental para reproduzibilidade e auditoria.

Etapa 2: Treinamento de modelos

O treinamento é automatizado por meio de pipelines de ML, sequências configuráveis de etapas que podem ser executadas sob demanda ou de forma programada. Isso elimina a necessidade de intervenção manual e permite que o modelo seja treinado novamente sempre que novos dados estiverem disponíveis.

Etapa 3: Validação e testes

Antes de ir a produção, cada nova versão do modelo passa por testes automatizados de performance: acurácia, precisão, recall, latência de inferência e testes de viés. Modelos que não atingem os limiares definidos são rejeitados automaticamente, sem que um ser humano precise tomar essa decisão.

Etapa 4: Deploy em produção

O deploy de modelos no MLOps segue práticas do DevOps: canary releases (implantação gradual para um subconjunto de usuários), A/B testing entre versões e rollback automatizado em caso de degradação. O objetivo é nunca interromper o negócio durante atualizações do modelo.

Etapa 5: Monitoramento contínuo

Um modelo em produção precisa ser monitorado continuamente. O MLOps rastreia dois tipos principais de degradação:

- Data drift: quando a distribuição dos dados de entrada muda em relação ao que o modelo aprendeu;

- Concept drift: quando a relação entre as variáveis de entrada e o resultado esperado muda (ex: o comportamento do cliente evolui);

Etapa 6: Re-treinamento contínuo (CI/CT)

Quando o monitoramento detecta degradação, o pipeline de re-treinamento é acionado automaticamente. Isso é chamado de Continuous Training (CT) — a extensão do CI/CD do DevOps para o mundo de machine learning.

Principais componentes de um pipeline de MLOps

Um pipeline de MLOps maduro é composto por cinco componentes fundamentais:

| Componente | O que faz | Por que é crítico |

| Versionamento de dados e modelos | Registra exatamente quais dados e qual código geraram cada versão do modelo | Permite reproduzibilidade e auditoria |

| Automação de pipelines | Executa as etapas de treinamento, validação e deploy sem intervenção manual | Elimina erros humanos e acelera ciclos |

| Testes e validação automatizados | Avalia cada nova versão do modelo antes de ir a produção | Evita que modelos degradados cheguem ao usuário final |

| Monitoramento de performance | Rastreia acurácia, latência e desvios de dados em tempo real | Detecta problemas antes que impactem o negócio |

| Governança e compliance | Registra quem treinou, quando, com quais dados e quais parâmetros | Essencial em setores regulados (saúde, financeiro, jurídico) |

MLOps vs DevOps: qual a diferença?

MLOps é inspirado no DevOps, mas não é a mesma coisa. Entender as diferenças é essencial para não tentar aplicar as práticas erradas ao contexto errado.

| Dimensão | DevOps | MLOps |

| Artefato principal | Código-fonte | Código + dados + modelo treinado |

| O que é versionado | Código e binários | Código, dados, hiperparâmetros e modelos |

| O que degrada em produção | Bugs introduzidos por código | Dados e comportamento do mundo real (drift) |

| Testes | Unitários, integração, performance | Unitários + validação de performance do modelo + teste de viés |

| Monitoramento | Erros de sistema, latência | Data drift, concept drift, acurácia e latência de inferência |

| Complexidade de deploy | Alta (mas dominada) | Muito alta (modelos podem ser não-determinísticos) |

| Equipes envolvidas | Dev + Ops | Dev + Ops + Data Science + Engenharia de Dados |

A principal diferença: no DevOps, o software se comporta de forma determinística, o mesmo código produz o mesmo resultado. No MLOps, o modelo é probabilístico e depende dos dados que mudam. Isso adiciona uma camada de complexidade que o DevOps não foi projetado para lidar.

Ferramentas de MLOps: o ecossistema

O ecossistema de ferramentas de MLOps cresceu significativamente nos últimos anos. As principais categorias incluem:

- Versionamento de dados e experimentos: MLflow, DVC, Weights & Biases

- Orquestração de pipelines: Apache Airflow, Kubeflow Pipelines, Vertex AI Pipelines

- Registro e monitoramento de modelos: MLflow Model Registry, Vertex AI Model Registry, Evidently AI

- Plataformas unificadas de ML: Google Vertex AI, Amazon SageMaker, Azure Machine Learning, Databricks

- Infraestrutura de serving: Kubernetes, KServe, Ray Serve

A tendência do mercado é a consolidação em plataformas unificadas, que cobrem todo o ciclo de vida em um único ambiente, em detrimento da necessidade de integrar múltiplas ferramentas pontuais.

MLOps no Google Cloud: Vertex AI como plataforma central

O Google Cloud oferece uma das plataformas de MLOps mais completas do mercado através do Vertex AI, uma plataforma unificada para desenvolvimento, treinamento, deploy e monitoramento de modelos de machine learning.

O que o Vertex AI oferece para MLOps?

- Vertex AI Pipelines: orquestração de pipelines de ML baseada em Kubeflow Pipelines, automatiza o ciclo completo de treinamento e deploy;

- Vertex AI Model Registry: centraliza o registro, versionamento e ciclo de vida de todos os modelos da organização;

- Vertex AI Model Monitoring: monitora automaticamente data drift, prediction drift e qualidade das features em produção;

- Vertex AI Experiments: rastreia experimentos de machine learning com versionamento de métricas, parâmetros e artefatos;

- Integração com BigQuery: acesso direto a grandes volumes de dados estruturados sem exportações manuais;

- Suporte ao Gemini: para organizações que desenvolvem aplicações de IA generativa, o Vertex AI é a plataforma de operacionalização dos modelos Gemini.

Por que o Vertex AI se destaca:

Enquanto muitas organizações precisam integrar 5 a 8 ferramentas diferentes para cobrir o ciclo completo de MLOps, o Vertex AI centraliza desenvolvimento, treinamento, avaliação, deploy, monitoramento e governança em um único ambiente. Para organizações que já operam no Google Cloud, isso reduz significativamente a complexidade operacional e os custos de integração.

Veja mais sobre as capacidades de IA no Google Cloud em nosso artigo sobre Google Vertex AI e sobre as principais ferramentas de inteligência artificial do Google Cloud.

Os três níveis de maturidade em MLOps

O Google Cloud define três níveis de maturidade em MLOps, que orientam a evolução das organizações nessa disciplina:

Nível 0: MLOps Manual

Todo o processo — preparação de dados, treinamento, validação e deploy — é feito manualmente por cientistas de dados. O código de treinamento e o modelo são tratados separadamente. Não há pipeline automatizado. Típico em organizações no início da jornada de IA.

Nível 1: automação de Pipeline de ML

O pipeline de treinamento é automatizado e pode ser acionado por novos dados. O deploy do modelo ainda pode ser manual, mas o re-treinamento ocorre de forma programada ou por gatilho. O monitoramento começa a ser implementado.

Nível 2: automação do Pipeline de CI/CD

Todo o ciclo é automatizado: treinamento, validação, deploy e monitoramento. Qualquer mudança no código ou nos dados aciona automaticamente o pipeline completo, incluindo testes, aprovações e deploy em produção. É o nível de maturidade exigido para a escala real de IA em grandes organizações.

Nível de maturidade brasileiro em MLOps

A maioria das empresas brasileiras que adota IA está no Nível 0 ou em transição para o Nível 1.

O salto para o Nível 2 — que é onde a IA começa a gerar valor competitivo sustentável — exige tanto mudança técnica quanto mudança cultural: equipes de ciência de dados precisam trabalhar em conjunto com engenharia de dados e operações de TI, com processos compartilhados e responsabilidades bem definidas.

MLOps é a base que decide se a IA escala ou fica no laboratório

Criar modelos de machine learning está cada vez mais acessível. Ferramentas de baixo código, plataformas de AutoML e modelos pré-treinados democratizaram o desenvolvimento de IA. Mas operacionalizar IA com confiabilidade, isso ainda separa as organizações que escalam de verdade das que acumulam projetos de prova de conceito.

MLOps não é sobre tecnologia. É sobre disciplina operacional aplicada à inteligência artificial. É o conjunto de práticas que garante que o investimento em IA se traduza em resultados reais, não em modelos que funcionam no notebook do cientista de dados mas nunca chegam ao cliente.

Para empresas que utilizam o Google Cloud, o Vertex AI oferece a infraestrutura para implementar MLOps em todos os níveis de maturidade, do pipeline inicial até a automação completa de CI/CT/CD para modelos em produção.

Quer levar seus projetos de inteligência artificial para produção com segurança e escalabilidade?

Fale com os especialistas da IPNET by Vivo e descubra como implementar MLOps no Google Cloud com Vertex AI, do primeiro pipeline à automação completa do ciclo de vida dos seus modelos.

FAQ — Perguntas frequentes sobre MLOps

O que é MLOps?

MLOps (Machine Learning Operations) é a disciplina que une práticas de machine learning, engenharia de software e operações para automatizar, padronizar e monitorar o ciclo de vida completo de modelos de IA em produção.

Qual a diferença entre MLOps e DevOps?

DevOps é voltado para o ciclo de vida de software, onde o artefato principal é o código. MLOps estende o DevOps para lidar com modelos de machine learning — que além de código dependem de dados, hiperparâmetros e re-treinamento contínuo. Modelos degradam com o tempo por mudanças nos dados, algo que o código tradicional não faz.

Por que a maioria dos projetos de IA não vai a produção?

A principal causa é a ausência de MLOps. Sem processos automatizados de deploy, monitoramento e re-treinamento, o modelo fica preso no ambiente de desenvolvimento — dependente de intervenção manual para qualquer atualização.

O que é data drift e por que importa no MLOps?

Data drift ocorre quando a distribuição dos dados de entrada muda em relação ao que o modelo foi treinado para processar. Isso causa degradação silenciosa da performance. O MLOps rastreia esse fenômeno continuamente e aciona re-treinamento quando necessário.

Qual ferramenta o Google Cloud usa para MLOps?

O Google Cloud oferece o Vertex AI como plataforma unificada de MLOps — cobrindo pipelines, registro de modelos, monitoramento, experimentos e deploy em um único ambiente.

MLOps é só para grandes empresas?

Não. Qualquer organização que coloca modelos de machine learning em produção se beneficia de MLOps. O nível de automação escala conforme a necessidade: começar com pipelines simples já é MLOps — e é infinitamente melhor do que processos totalmente manuais.

Quais equipes precisam estar envolvidas em MLOps?

MLOps é uma disciplina colaborativa: cientistas de dados, engenheiros de dados, engenheiros de ML e times de operações de TI precisam trabalhar juntos. A separação entre quem cria o modelo e quem opera é um dos principais gargalos que o MLOps resolve.